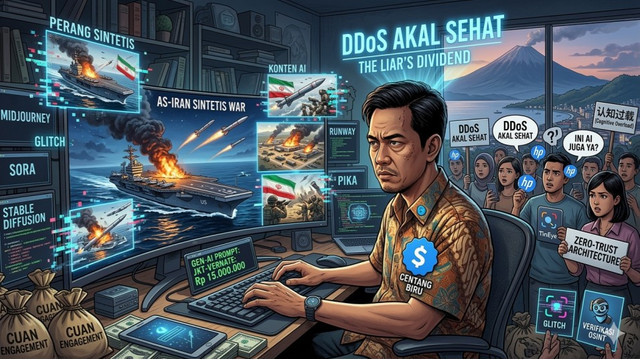

Kiamat Sintetis: Jualan Perang Fiktif AS-Iran Demi 'Cuan' Centang Biru

Pengajar IT yang lebih sering menemukan bug pada birokrasi daripada di aplikasi. Menulis tentang IT, kampus, dan dunia digital dari bawah kaki gunung gamalama.

·waktu baca 5 menit

Tulisan dari Abd Rahman tidak mewakili pandangan dari redaksi kumparan

Jika Anda membuka lini masa media sosial (khususnya X/Twitter) di tengah memanasnya eskalasi geopolitik antara Amerika Serikat dan Iran belakangan ini, Anda akan disuguhi pemandangan kiamat kecil yang sangat sinematik.

Kilatan cahaya rudal balistik yang membelah langit malam, kilang minyak yang terbakar hebat, hingga siluet kapal induk raksasa yang seolah-olah sedang tenggelam dilalap api berseliweran di layar smartphone kita. Ribuan retweet mengalir. Kolom komentar penuh dengan caci maki, doa, dan kepanikan global.

Namun, ada satu rahasia kelam di balik dramatisasi visual tersebut: Sebagian besar gambar dan video itu tidak pernah terjadi di dunia nyata. Ia tidak direkam oleh lensa satelit atau kamera jurnalis perang, melainkan diproduksi dari rahim algoritma Generative AI di sebuah kamar yang sejuk dan aman.

Selamat datang di era Algorithmic Warfare (Perang Algoritma), di mana kebenaran telah menjadi korban pertama yang dieksekusi, bahkan sebelum peluru sungguhan ditembakkan.

Dari "Perang TikTok" ke "Perang Sintetis"

Untuk memahami evolusi gila ini, kita harus membandingkan anatomi perang modern.

Ketika invasi Rusia ke Ukraina meletus pada 2022, para analis militer menjulukinya sebagai "Perang TikTok Pertama". Medannya adalah perang darat konvensional: parit berlumpur, konvoi tank baja yang merangsek maju, dan artileri berat. Bukti-bukti perang saat itu didominasi oleh video amatir dari kamera GoPro di helm tentara. Saat itu, AI masih dalam tahap bayi merangkak.

Namun, konflik AS-Iran hari ini memiliki arsitektur yang sama sekali berbeda. Tidak ada barisan tank yang saling berhadapan. Ini adalah perang asimetris jarak jauh. Medannya berada di udara, perairan terbuka, ruang siber, dan jalur logistik—melibatkan proksi, kapal perusak, drone kamikaze, sistem pertahanan udara (interceptor), dan rudal balistik. Rakyat sipil sangat jarang melihat musuh secara langsung; mereka hanya melihat kilatan cahaya di langit malam.

Di sinilah letak celah berbahayanya. Karena minimnya footage (rekaman) pertempuran jarak dekat yang bisa diakses publik, para oknum peternak interaksi (Engagement Farmers) yang berlindung di balik status langganan "Centang Biru" di X/Twitter memanfaatkan Generative AI untuk mengisi kekosongan visual tersebut.

Mereka mengetik prompt ke aplikasi pembuat gambar open-source seperti Midjourney dan Stable Diffusion, atau AI video generator seperti Runway dan Pika: "Buatkan video realistis pangkalan militer AS di Timur Tengah terbakar dihantam rudal pada malam hari". Dalam hitungan detik, mesin memuntahkan visual yang mengerikan.

Konflik AS-Iran pun resmi menjadi "Perang Sintetis Pertama".

Serangan DDoS pada Akal Sehat: Teori The Liar's Dividend

Banyak orang mengira bahwa bahaya terbesar dari AI adalah kemampuannya membuat publik percaya pada kebohongan. Namun, dalam disiplin ilmu Hukum Teknologi dan Keamanan Siber, ancaman tertingginya justru jauh lebih mematikan dari itu.

Profesor Robert Chesney dan Profesor Danielle Citron (2018) merumuskan sebuah konsep akademis yang sangat brilian bernama The Liar's Dividend (Keuntungan Sang Pembohong).

Konsep ini menyatakan bahwa keberadaan teknologi Deepfake dan AI tidak hanya membuat hal yang palsu terlihat nyata, tetapi yang paling fatal: ia membuat hal yang nyata, menjadi terlihat palsu.

Mari kita analogikan dengan serangan DDoS (Distributed Denial-of-Service) pada sebuah server komputer. Dalam serangan DDoS, hacker mengirimkan jutaan traffic sampah (data palsu) secara bersamaan hingga server kelebihan beban (overload) dan lumpuh, sehingga traffic yang asli tidak bisa masuk.

Begitu pula yang dilakukan AI terhadap kognisi manusia. Setiap hari, otak kita dibombardir dengan ratusan video ledakan palsu. Akibatnya, otak publik mengalami Cognitive Overload (kelelahan kognitif) dan menjadi sangat apatis terhadap apa pun yang mereka lihat di layar.

Lalu, tibalah momen puncak dari The Liar's Dividend.

Bayangkan suatu hari, sebuah rudal sungguhan benar-benar nyasar dan menghantam pemukiman sipil. Tragedi itu direkam oleh saksi mata. Namun, sang pelaku kejahatan perang bisa dengan santai menggelengkan kepala di konferensi pers dan merapal satu kalimat sakti penutup dosa: "Itu bukan kami. Video itu jelas buatan AI. Hati-hati propaganda."

Karena publik sudah terlalu sering ditipu oleh konten AI, mereka akhirnya akan mengangguk ragu. "Iya juga ya, jangan-jangan ini AI lagi." Di detik itulah, keadilan mati tercekik. Sang pelaku kejahatan perang bebas dari sanksi internasional, melenggang tanpa dosa, bersembunyi di balik bayang-bayang keraguan yang diciptakan oleh algoritma. Inilah keuntungan (dividend) terbesar bagi sang pembohong.

Protokol Bertahan: Zero-Trust Architecture

Lalu, bagaimana kita selamat dari perang halusinasi ini? Sebagai warga sipil digital, kita harus mengadopsi prinsip Zero-Trust Architecture (Jangan Percaya Siapa Pun Sebelum Diverifikasi).

1. Jangan Percaya pada 'Malam Hari' dan 'Api'

Algoritma AI saat ini sangat ahli menyembunyikan kecacatan rendering-nya di balik visual malam hari, asap tebal, dan kilatan api. Jika Anda melihat video dramatis berlatar malam tanpa sumber jurnalistik yang jelas, asumsikan itu adalah AI tingkat default.

2. Audit Anatomi Fisika (Cari Glitch Sistem)

Carilah anomali hukum fisika. Perhatikan kepulan asap—apakah pergerakannya berulang seperti animasi looping? Apakah pantulan cahaya ledakan di atas permukaan air laut sinkron dengan sumber apinya? AI sering kali gagal menghitung rasio spasial secara presisi.

3. Gunakan OSINT (Open Source Intelligence)

Jangan pernah menelan mentah-mentah narasi dari akun media sosial, meskipun mereka punya lencana centang biru. Gunakan fitur Reverse Image Search (Google Lens, Yandex, atau TinEye). Jika gambar ledakan tersebut ternyata adalah foto insiden di tempat lain pada tahun 2015 yang dimanipulasi, Anda baru saja menyelamatkan akal sehat Anda.

Pada akhirnya, peradaban kita sedang dipaksa menelan ironi yang sangat pahit.

Kita membanggakan Artificial Intelligence (Kecerdasan Buatan) yang mengalami upgrade kualitas gila-gilaan setiap detiknya. Namun di saat yang sama, Human Intelligence (Kecerdasan Kemanusiaan) kita justru mengalami downgrade massal karena terlalu malas melakukan verifikasi dan terlalu bernafsu membagikan amarah untuk mengumpulkan likes.

Di era Perang Sintetis ini, sikap skeptis dan menahan jari untuk tidak langsung menekan tombol Share bukanlah bentuk ketidakpedulian. Ia adalah bentuk perlawanan intelektual paling radikal yang bisa Anda lakukan demi menjaga agar kebenaran tidak mati di tangan algoritma.