Roh, Kuasa, dan Wacana (Membaca AI melalui Hegel, Foucault, & Habermas) (Bag II)

Dimitri Mahayana:Dosen Filsafat Sains S3 di STEI ITB.Pakar ICT lulusan Waseda University, Jepang & founder konsultan ICT Sharing Vision, Bandung.

·waktu baca 4 menit

Tulisan dari Filsafat Sains Dimitri Mahayana tidak mewakili pandangan dari redaksi kumparan

Panopticon Digital Kuasa, Kebenaran, dan AI sebagai Mesin Normalisasi

Kebenaran Bukan Ditemukan, Melainkan Diproduksi

Jika Hegel melihat sejarah sebagai perjalanan Roh menuju kebebasan, Foucault melihat sejarah sebagai medan pertempuran di mana kekuasaan bersembunyi di balik klaim kebenaran. Bagi Foucault, tidak ada 'kebenaran' yang berdiri sendiri, netral, dan bebas dari kepentingan. Setiap régime de vérité — rezim kebenaran — adalah produk dari relasi kuasa tertentu.

Konsep kunci Foucault adalah nexus kuasa-pengetahuan (pouvoir-savoir): kuasa dan pengetahuan tidak dapat dipisahkan. Sains bukan aktivitas bebas nilai yang kemudian 'dimanfaatkan' oleh kekuasaan; sains adalah salah satu cara utama kekuasaan beroperasi. Sekarang bayangkan pertanyaan yang sama diterapkan pada AI: Siapa yang mendefinisikan apa yang 'benar' dan 'salah' dalam model bahasa besar yang digunakan oleh miliaran orang?

"Truth is a thing of this world: it is produced only by virtue of multiple forms of constraint. And it induces regular effects of power."— Michel Foucault, Power/Knowledge, 1980

Kapitalisme Surveillance: Panopticon Digital

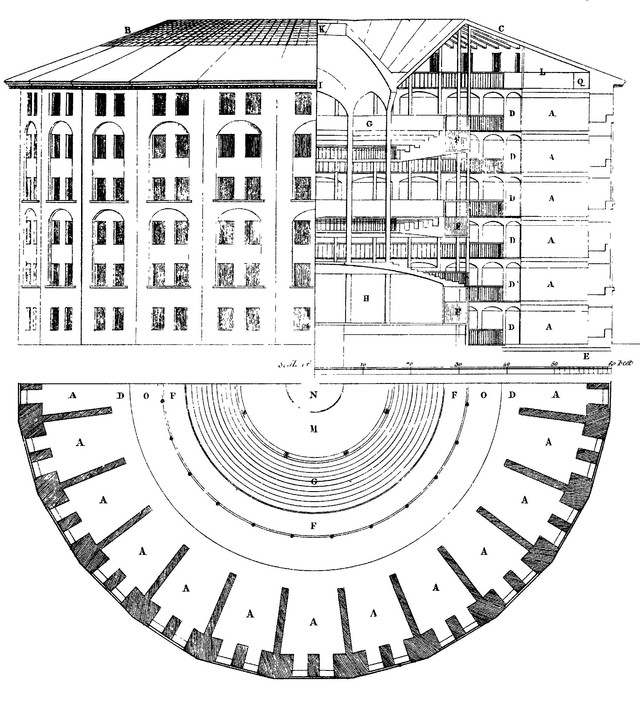

Jeremy Bentham merancang Panopticon — penjara melingkar di mana satu penjaga di menara tengah dapat mengawasi semua tahanan tanpa diketahui apakah ia sedang mengawasi atau tidak. Foucault menggunakan arsitektur ini sebagai metafora bagi seluruh masyarakat modern: kita berperilaku seolah-olah selalu diamati, dan dengan demikian kita menginternalisasi pengawasan itu ke dalam diri kita sendiri.

Yang terjadi dalam era AI bukan hanya pengumpulan data perilaku manusia untuk dijual sebagai komoditas. Yang terjadi adalah penciptaan rezim kebenaran baru berbasis data — di mana 'apa yang benar tentang Anda' didefinisikan oleh algoritma milik korporasi, dan Anda tidak pernah tahu persis bagaimana definisi itu dibuat, digunakan, atau dijual.

Ketika model kredit menyatakan Anda 'berisiko tinggi' — siapa yang mendefinisikan 'risiko'? Ketika algoritma rekrutmen menyingkirkan CV Anda sebelum mata manusia melihatnya — siapa yang mendefinisikan 'kualifikasi'? Ini bukan sekadar masalah teknis tentang bias algoritma. Ini adalah pertanyaan Foucaultian yang paling mendasar: siapa yang memiliki hak untuk mendefinisikan, dan atas dasar kepentingan apa?

Genosida, Korban, dan Kebenaran yang Dikelola Algoritma

Di sinilah analisis Foucaultian tentang AI mencapai implikasinya yang paling menggelisahkan. Foucault menganalisis bagaimana kekuasaan bekerja melalui kontrol atas narasi sejarah — siapa yang memiliki hak untuk berbicara, dari sudut pandang apa, dan kepada siapa.

Model bahasa besar dilatih terutama pada teks berbahasa Inggris, dari sumber-sumber yang mengikuti standar editorial tertentu, yang beroperasi dalam kerangka geopolitik tertentu. Perspektif yang paling terwakili dalam data pelatihan — yang umumnya adalah perspektif media arus utama Barat — akan dominan. Perspektif korban yang tidak memiliki akses ke platform media internasional, yang berbicara dalam bahasa yang kurang terwakili, atau yang narasinya secara aktif disupres — perspektif itu tidak ada, atau hanya ada sebagai catatan kaki.

Ini adalah mekanisme produksi ketidakhadiran — sebuah cara kekuasaan bekerja bukan hanya dengan mengatakan hal yang salah, tetapi dengan memastikan bahwa suara-suara tertentu tidak pernah ada dalam ruang wacana yang dianggap sah. Ketika seorang penyintas genosida mencoba menggambarkan pengalamannya kepada sistem AI, dan sistem itu mengoreksi narasinya berdasarkan 'fakta' yang dominan dalam data pelatihannya — ini adalah kekerasan epistemik dalam bentuk yang paling halus dan paling berbahaya.

Yang paling berbahaya bukan AI yang berbohong. Yang paling berbahaya adalah AI yang, dengan ketulusan algoritmik, memantulkan kembali tatanan dunia yang tidak adil seolah-olah tatanan itu adalah kebenaran alam semesta.— Implikasi dari analisis Foucaultian tentang kuasa-pengetahuan dalam konteks AI

Si Kuat Makin Kuat, Si Lemah Makin Terkapar

Foucault dalam analisis genealogisnya selalu mempertanyakan: Siapa yang diuntungkan? Dan dengan cara apa? Pertanyaan ini, diterapkan pada AI, menghasilkan gambaran yang sangat buram.

Pengembangan model AI kelas dunia membutuhkan tiga hal yang hanya dimiliki oleh segelintir aktor: modal yang sangat besar, akses ke data dalam jumlah masif dan berkualitas tinggi, serta ekosistem talenta peneliti terbaik dunia. Konsentrasi ketiga sumber daya ini pada segelintir korporasi menciptakan apa yang dapat disebut sebagai oligopoli epistemik: segelintir entitas yang memiliki kemampuan untuk mendefinisikan, pada skala global, apa yang 'diketahui' oleh mesin-mesin paling cerdas yang pernah ada.

Yang paling menggembirakan bagi kekuasaan adalah bahwa sistem ini bersifat self-reinforcing: semakin banyak orang menggunakan AI yang dibangun oleh aktor dominan, semakin banyak data yang terkumpul, semakin kuat modelnya, semakin sulit bagi aktor lain untuk bersaing. Lingkaran ini adalah logika akumulasi kapital yang paling murni, yang kini telah berhasil mengkolonisasi ranah produksi pengetahuan itu sendiri. (Bersambung)